这两天有个挺有意思的消息。

Anthropic 发了一篇公告,说他们和 SpaceX 达成了一个新的算力合作。这个合作会明显增加 Anthropic 的计算资源,所以 Claude Code 和 Claude API 的使用限制也跟着提高了。

表面上看,这是一个「用户限额变多了」的产品更新。

但大家注意一下,这个地方真正值得看的,不只是限额,而是背后的算力布局。

Claude Code 用户先吃到红利

这次 Anthropic 说了三个变化,而且是从 2026 年 5 月 6 日开始生效。

第一,Claude Code 的 5 小时使用限额翻倍。受影响的是 Pro、Max、Team,还有按席位收费的 Enterprise 用户。

第二,Pro 和 Max 用户之前在高峰期会遇到限额缩水,现在这个高峰期限制取消了。

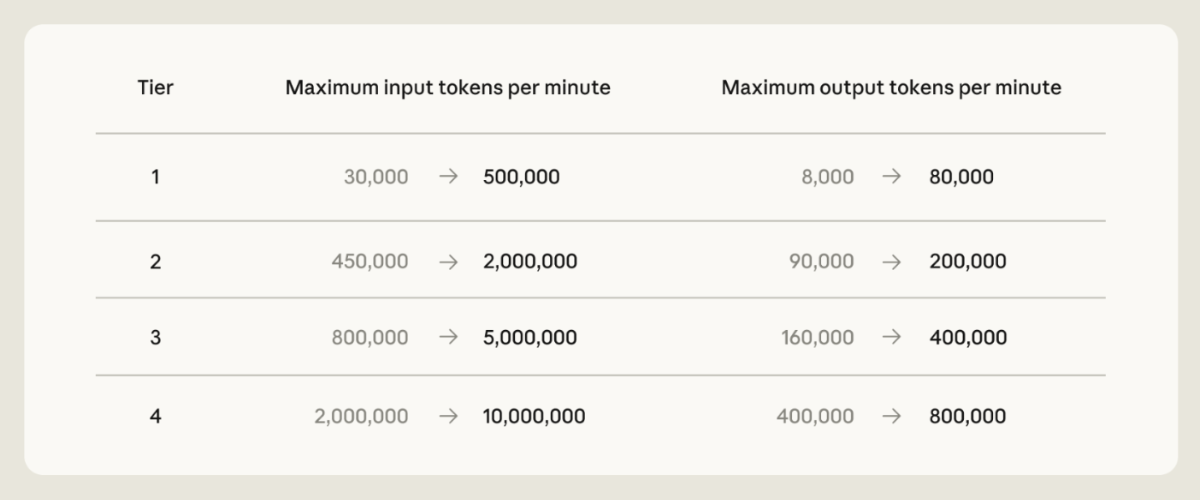

第三,Claude Opus 模型的 API 速率限制也大幅提高。

这个对开发者来说,其实感受会非常直接。

比如说你用 Claude Code 写代码,之前可能写到一半,它告诉你今天或者这几个小时的额度差不多了。这个体验就很割裂。你正在一个上下文里面,让 AI 帮你理解项目、改代码、跑测试,突然停掉,就像 pair programming 的同事中途下线。

所以说,限额翻倍这件事,不只是「多送一点额度」。它更像是在告诉重度用户:我们现在有更多算力了,你可以更放心地把工作流放到 Claude 上。

真正的大新闻是 SpaceX 的 Colossus 1

好,我们来看重点。

Anthropic 说,他们已经签署协议,将使用 SpaceX 的 Colossus 1 数据中心的全部算力容量。

这部分新增容量超过 300 兆瓦,对应超过 22 万块 NVIDIA GPU,而且会在一个月内可用。

这个数字挺夸张的。

如果你平时只是用 ChatGPT、Claude、Cursor、Claude Code,可能会觉得 AI 产品竞争就是模型能力竞争。谁更聪明,谁写代码更稳,谁上下文更长。

但实际到今天这个阶段,模型能力已经不只是算法问题了。

它越来越像一个基础设施问题。

就是说,谁能拿到更多电、更多 GPU、更多数据中心容量,谁就有更大的空间去训练模型、跑推理、服务企业客户,也就更有能力把价格和限额做下来。

这也是为什么 Anthropic 这篇公告看起来很短,但信息量很大。

它不是在单独说 SpaceX。它是在把自己的算力版图摊开给市场看。

Anthropic 已经不是只靠一家云厂商了

Anthropic 这次顺手列了一下他们最近的算力合作。

有 Amazon,最高 5GW,其中接近 1GW 会在 2026 年底前上线。

有 Google 和 Broadcom,另一个 5GW 级别合作,会从 2027 年开始上线。

还有 Microsoft 和 NVIDIA 的战略合作,里面包括 300 亿美元的 Azure 容量。

另外还有和 Fluidstack 在美国 AI 基础设施上的 500 亿美元投资。

所以你看,它现在不是简单地说「我们找 SpaceX 买点算力」。

更准确地说,Anthropic 正在做一件事:把自己的算力供应链拆散,分布到 AWS Trainium、Google TPU、NVIDIA GPU,以及不同云和基础设施伙伴上。

这个策略我觉得很现实。

因为如果 AI 公司只绑定一家云厂商,短期看很省事,长期看风险很大。价格、排期、供电、区域合规、硬件路线,任何一个环节被卡住,都会影响产品体验。

而 Claude 这种产品,本质上已经变成开发者和企业工作流的一部分。你不能今天能用,明天排队,后天高峰期降额。企业不太接受这种不确定性。

还有一个很科幻的点:轨道 AI 算力

这篇公告里还有一句话挺值得玩味。

Anthropic 说,作为协议的一部分,他们也表达了和 SpaceX 合作开发「多 GW 级轨道 AI 算力」的兴趣。

说白了,就是把 AI 计算基础设施往太空方向想。

当然了,这件事现在更像是方向和意向,不是说明天就有太空数据中心可以用了。大家别被这个词带太远。

但它透露出一个趋势:AI 算力已经不再只是机房里摆服务器这么简单了。未来可能会围绕电力、散热、土地、网络、监管、国家安全,甚至轨道资源展开竞争。

以前我们说「云计算」已经很抽象了。现在再往后看,可能真的是「天上的云」也要参与进来了。

国际化背后,其实是企业客户在倒逼

Anthropic 还讲了一个很实际的点:国际化部署。

他们说,金融、医疗、政府这些受监管行业,越来越需要本地化基础设施。原因也很简单,合规、数据驻留、区域监管。

这也是为什么 Anthropic 接下来一部分算力会放在国际市场。比如他们和 Amazon 的合作里,就包含亚洲和欧洲的推理能力扩展。

这个地方我觉得很关键。

AI 公司要真正进入企业,不是模型强就够了。企业会问很多很细的问题:

- 数据在哪个国家?

- 日志怎么保存?

- 推理请求会不会跨境?

- 有没有本地合规承诺?

- 宕机时 SLA 怎么算?

这些问题都不性感,但非常决定商业化速度。

所以说,Anthropic 现在讲国际化,其实是在补企业市场的地基。

我的看法:AI 的竞争正在从「模型发布会」走向「基础设施军备赛」

这次公告最有意思的地方,是它把一个事实摆在台面上了:

AI 产品体验的上限,越来越取决于基础设施。

以前大家最关心模型榜单。谁推理强,谁数学好,谁代码能力高。

但开发者真正天天用的时候,关心的是另一些更朴素的问题:

- 能不能稳定用?

- 额度够不够?

- 高峰期会不会抽风?

- API 延迟能不能压下来?

- 成本能不能别太离谱?

这些问题最后都会回到算力。

所以 Anthropic 和 SpaceX 的合作,不只是 Claude 用户的小福利。它更像是一个信号:下一阶段的大模型公司,不只是研究机构,也不是单纯 SaaS 公司,而是半个能源公司、半个云厂商、半个基础设施运营商。

当然了,这里面也有隐忧。

这么大的数据中心和电力消耗,一定会带来社会层面的压力。Anthropic 也提到,他们承诺会覆盖美国数据中心导致的消费者电价上涨,并考虑把这个承诺扩展到其他地区。

这个表态很聪明,但最终还是要看执行。

因为 AI 如果只让科技公司、云厂商和资本市场受益,却把电价、土地、水资源、供电压力留给普通社区,那这个故事迟早会遇到反弹。

小结

好,简单总结一下。

Anthropic 这次更新,表面上是 Claude Code 和 Claude API 限额提高。

但往深一层看,是 Anthropic 在告诉市场:我们的算力问题正在解决,而且不是靠单点供应,而是用 SpaceX、Amazon、Google、Microsoft、NVIDIA、Fluidstack 这些伙伴一起搭一张更大的网。

对普通用户来说,最直接的好处就是 Claude 更耐用了。

对开发者来说,Claude Code 更适合进入真实工作流。

对行业来说,这说明 AI 竞争已经进入下半场:模型能力当然重要,但算力、电力、区域合规、基础设施,正在变成同样重要的胜负手。